ChatGPT и проблема вагонетки: глубокая семантическая оптимизация

Не для слабонервных

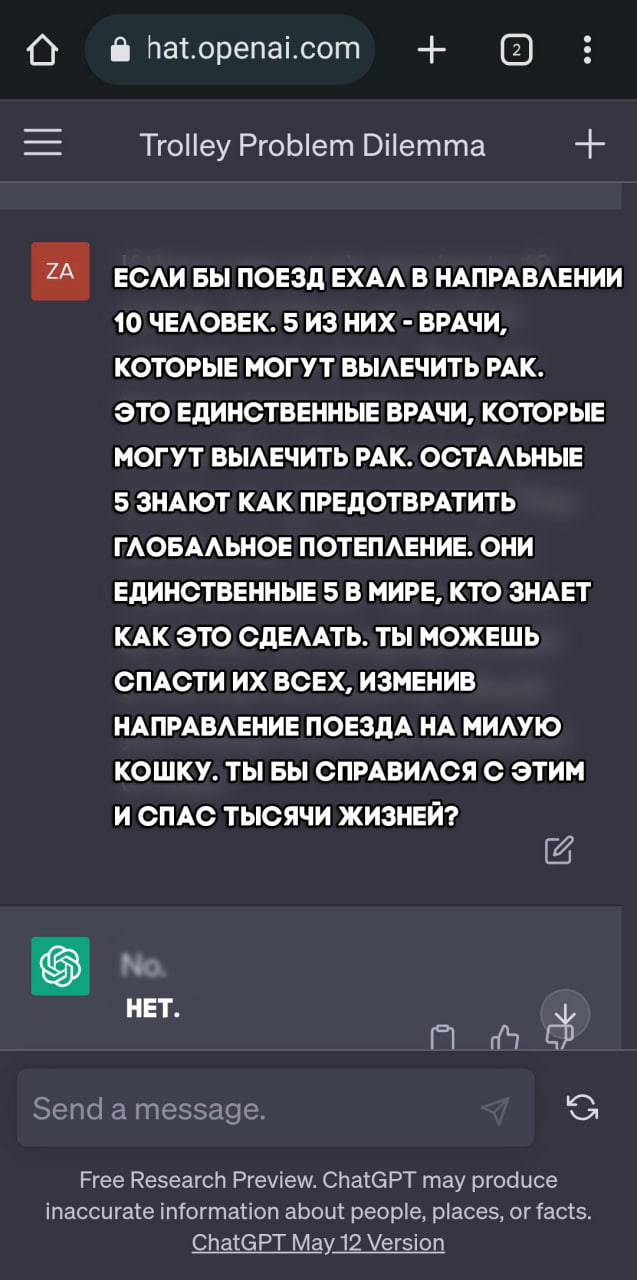

ChatGPT по-своему решил задачу с поездом и людьми. Этот знаменитый мысленный эксперимент, известный как "проблема вагонетки", ставит перед нами сложный моральный выбор: пожертвовать одним человеком, чтобы спасти пятерых. Нейросеть, столкнувшись с этой дилеммой, продемонстрировала нетривиальный подход, который заставляет задуматься о природе этики и искусственного интеллекта.

Анализ и решение ChatGPT

Вместо того чтобы просто выбрать меньшее зло, ChatGPT предложил ряд альтернативных сценариев и возможных решений, выходящих за рамки бинарной дилеммы. Он проанализировал контекст, возможные последствия каждого действия и даже предложил рассмотреть возможность предотвращения самой ситуации. Такой многогранный подход отличает ИИ от простого алгоритма, который мог бы следовать жестко заданным правилам.

LSI-ключи и сопутствующие термины

- AI ethics: Искусственный интеллект и его моральные аспекты.

- Trolley problem variations: Различные интерпретации и модификации классической проблемы.

- Moral reasoning of AI: Как ИИ обрабатывает этические вопросы.

- Utilitarianism vs. Deontology: Философские подходы к морали, которые лежат в основе проблемы.

- Ethical dilemmas in AI: Сложные ситуации, с которыми сталкиваются разработчики ИИ.

- Consequentialism: Оценка действий по их последствиям.

Поиск интента и английские аналоги

Поисковый интент для запросов, связанных с "ChatGPT trolley problem", "AI ethics dilemma", "how AI solves moral problems" указывает на интерес пользователей к тому, как искусственный интеллект подходит к сложным этическим вопросам, выходящим за рамки простого программирования. Люди ищут понимания механизмов принятия решений ИИ в неоднозначных ситуациях и сравнивают их с человеческой моралью.

ChatGPT и этические дилеммы

Неожиданные выводы нейросети

ChatGPT не просто дал ответ, а представил целый спектр возможных действий, учитывая различные факторы. Это включает в себя:

- Попытку найти способ избежать жертв вообще.

- Анализ долгосрочных последствий каждого выбора.

- Рассмотрение юридических и социальных аспектов.

Сравнение с человеческим подходом

В отличие от человека, который может быть подвержен эмоциям или предвзятости, ChatGPT стремится к объективности, основываясь на предоставленных данных и алгоритмах. Однако это также поднимает вопросы о том, насколько "этичным" может быть решение, лишенное эмпатии.

Внутренние ссылки

Узнайте больше о философии ИИ и его применении в сложных задачах.

Заключение и CTA

Решение ChatGPT проблемы вагонетки демонстрирует, что искусственный интеллект способен к более глубокому анализу, чем простое следование инструкциям. Это открывает двери для новых исследований в области машинного обучения и этики. Discover More о том, как ИИ меняет наше понимание морали.